Какая арматура нужна для фундамента дома | Цемент-Снаб

Длительная безаварийная эксплуатация жилого дома зависит от качества фундамента. Поэтому при его устройстве необходимо тщательно выполнять требования проектной документации. При этом особое внимание надо обратить на армирование несущих элементов фундамента.

Если оно выполнено неправильно или полностью отсутствует, то возникнет неравномерная осадка дома и в стенах могут появиться трещины. Они будут постепенно расширяться, что приведет к разрушению несущих конструкций.

Какие бывают фундаменты для дома

Существует несколько разновидностей фундаментов для жилых домов, которые армируются по-разному в зависимости от этажности здания, несущей способности грунтов, состояния рельефа:

- Ленточные. Используются для строительства жилых домов высотой до пяти этажей на плотных грунтах;

- Свайные буронабивные. Применяются для возведения малоэтажных строений на просадочных грунтах с высоким уровнем грунтовых вод;

- Плитные.

Считаются самыми прочными и предназначены для высотного строительства на любых грунтах, кроме переувлажненных.

Считаются самыми прочными и предназначены для высотного строительства на любых грунтах, кроме переувлажненных.

Каждый тип фундаментов армируется по-разному, для чего используется арматура разного класса.

Разновидности арматуры

При выборе способа армирования необходимо учитывать следующие характеристики арматурной стали:

- Внешний вид;

- Класс арматуры;

- Марка стали.

В строительстве используются следующие разновидности арматуры:

- Горячекатаная. Обозначается буквой А. Имеет гладкую и рифленую поверхность;

- Холоднодеформированная высокопрочная. Обозначается буквами Вр. Имеет слегка деформированную поверхность;

- Канатная. Обозначается буквой К. Состоит из пучка тонких стальных проволочек.

Армирование ленточных фундаментов

Этот тип основания является наиболее распространенным, так как стоит дешевле плитного и позволяет смонтировать цокольный этаж. Ленточные фундаменты меньше подвержены изгибам, деформации поэтому армируются с учетом нагрузок, размеров дома. Бетонируются ниже уровня промерзания грунтов.

Бетонируются ниже уровня промерзания грунтов.

Для армирования подошвы используются сетки из рабочей арматуры класса АΙΙ-ΙΙΙ Ø 12-14 мм, распределительной класса АΙ Ø 6 мм. Стены фундамента армируются каркасами. Для этого используется рабочая арматура 10 мм АΙΙΙ, распределительная 5-6 мм АΙ.

Каркасы и сетки собираются из прутков, хомутов, которые соединяются между собой вязальной проволокой. Они устанавливаются в деревянную извлекаемую или шиферную неизвлекаемую опалубку. При этом важно создать с помощью фиксаторов защитный слой из бетона, который предохраняет арматуру от коррозии.

Количество прутков в каркасах зависит от величины нагрузок, которые будет испытывать фундамент. Определяется расчетным путем при проектировании с учетом несущей способности грунтов. Общее количество арматуры в ленточных фундаментах должно составлять не менее 25-30 кг/м³.

Армирование свайных фундаментов

Для этого в пробуренные скважины глубиной до 4-5 метров опускают круглые каркасы, состоящие из рабочей арматуры Ø 12-14 мм класса АΙΙ-ΙΙΙ, распределительной Ø6 мм класса АΙ. При этом особое внимание уделяется созданию защитного слоя толщиной не менее 5 мм, так как сваи подвергаются агрессивному воздействию грунтовых вод.

При этом особое внимание уделяется созданию защитного слоя толщиной не менее 5 мм, так как сваи подвергаются агрессивному воздействию грунтовых вод.

Скважины пробуриваются до плотного грунта и после установки каркасов, заполняются бетоном М300. После твердения оголовки свай соединяются монолитным ростверком. Он армируется каркасами из арматуры АΙΙ-ΙΙΙ Ø14-16 мм АΙ Ø 6 мм. В местах стыковки рабочая арматура каркасов соединяется между собой электросваркой с длиной шва не менее 10 Ø.

Армирование плитных фундаментов

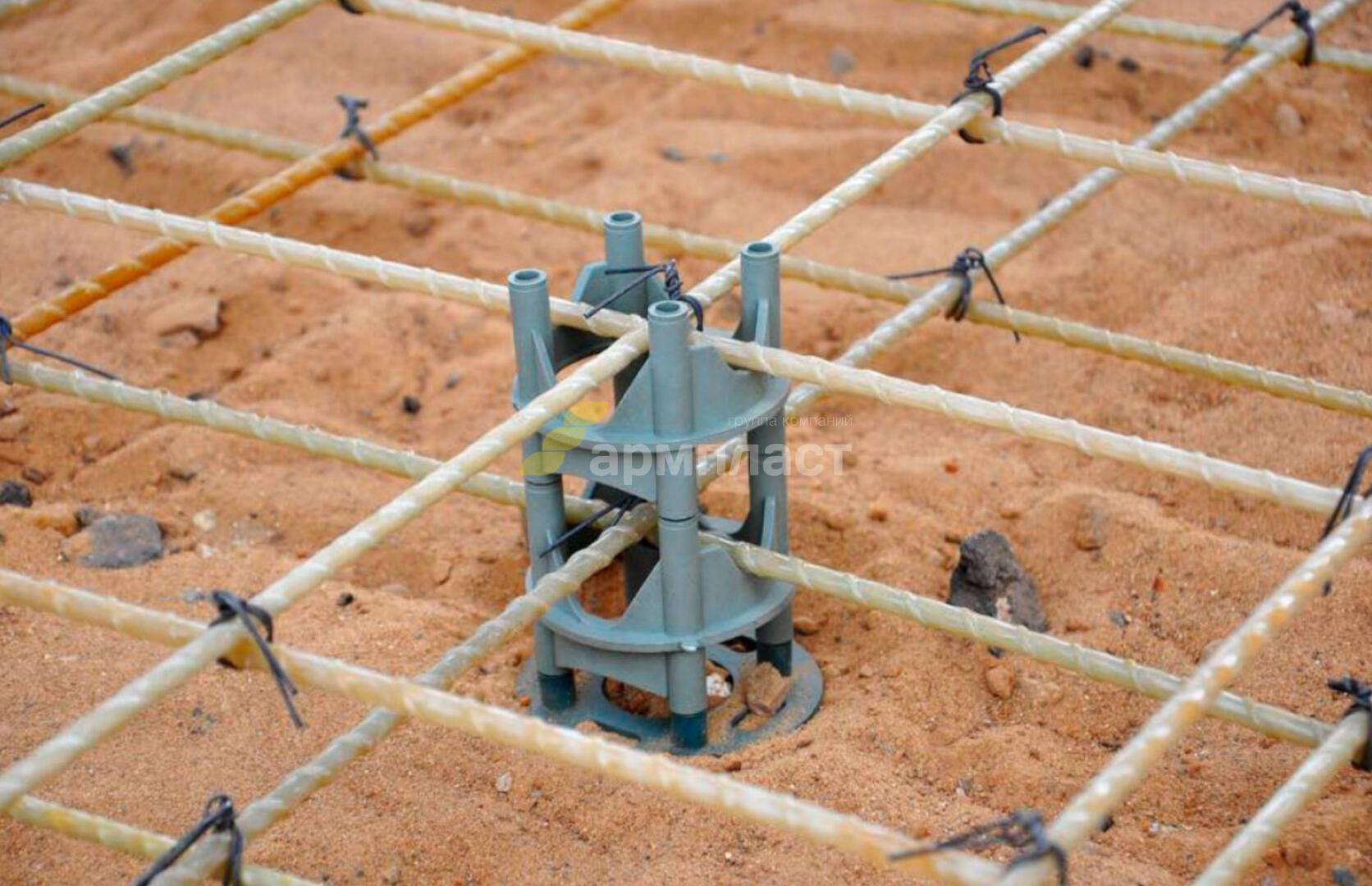

Такие конструкции должны выдержать значительные нагрузки от высотных домов. Поэтому армируются пространственным каркасом, состоящим из двух сеток, которые разделены между собой на определенное расстояние с помощью специальных фиксаторов. Сетки состоят только из рабочей арматуры класса АΙΙΙ Ø 16-18 мм.

Стержни располагаются перпендикулярно друг к другу и соединяются вязальной проволокой в шахматном порядке. Сам фундамент состоит из дренирующего слоя толщиной 0,5 м, бетонной подготовки 20 см и армированной плиты 30-40 см в зависимости от высоты дома и состояния грунтов.

Другие типы фундаментов

Если возникла необходимость в холодное время года срочно смонтировать ленточный фундамент, то можно купить фундаментные блоки вместе с подушками. Они монтируются с колес в готовые траншеи на основание из песка толщиной 10-15 см.

Такой фундамент можно смонтировать за несколько дней. Блоки соединяются между собой раствором из пескобетона М300. Верхняя часть такой конструкции обвязывается монолитным железобетонным поясом из арматуры класса АΙΙ Ø12-14 мм и АΙ Ø6 мм.

Общие рекомендации

При сборке каркасов важно соблюдать все требования проектной документации, особенно что касается расположения арматурных стержней, хомутов в пространстве. Замену прутков на другие диаметры и классы может осуществить или согласовать только разработчик проекта.

« Для чего нужна отмостка вокруг дома | Варианты отделки фасада загородного дома »

Арматура для фундамента

КАЧЕСТВЕННАЯ АРМАТУРА НАДЁЖНЫЙ ФУНДАМЕНТ!!!

Арматура для фундамента (прайс)

| Металл | Цена за тн | Цена за мп | ||

Арматура А3 Ø6 класс А500С, длина 6м, 9м | 88600 р/тн | 20 руб/мп | Заказать | |

Арматура А3 Ø8 класс А500С, длина 6м, 9м | 80800 р/тн | 33 руб/мп | Заказать | |

Арматура А3 Ø10 класс А500С , длина 11. | 77100 р/тн | 48 руб/мп | Заказать | |

Арматура А3 Ø12 класс А500С , длина 11.7м | 74600 р/тн | 67 руб/мп | Заказать | |

Арматура А3 Ø14 класс А500С , длина 11.7м | 74100 р/тн | 94 руб/мп | Заказать | |

Арматура А3 Ø16 класс А500С , длина 11.7м | 74100 р/тн | 122 руб/мп | Заказать | |

| Проволока вязальная | 1,2 | звоните | 48 руб/кг | Заказать |

| Общий прайс на арматуру>>> | ||||

Наша компания занимается продажей арматуры для фундамента по выгодным ценам. Нашим клиентам мы предлагаем качественную продукцию Российского производства имеющую все необходимые сертификаты качества. Продажа возможна самовывозом со склада в Москве или доставкой до вашего объекта. Оформить заказ можно онлайн через форму на сайте, позвонив нашим менеджерам 8 (495) 946-91-69 или отправив заказ на почту E-mail: [email protected] Мы предлагаем оперативную доставку 24/7 и разные способы оплаты арматуры: безналичный расчёт, оплата курьеру по доставке.

Продажа возможна самовывозом со склада в Москве или доставкой до вашего объекта. Оформить заказ можно онлайн через форму на сайте, позвонив нашим менеджерам 8 (495) 946-91-69 или отправив заказ на почту E-mail: [email protected] Мы предлагаем оперативную доставку 24/7 и разные способы оплаты арматуры: безналичный расчёт, оплата курьеру по доставке.

Арматура для фундамента диаметры и виды

Строительство дома начинается с фундамента. А для заливки необходимо связать стальной каркас. Для этого используют арматуру. В основном в частном строительстве применяются следующие диаметры арматуры рифленой А3 А500С 8 мм, 10 мм, 12 мм, 14 мм, 16 мм, для обвязки используют арматуру гладкую А1 А240 диаметром 6,5 мм, 8 мм редко 10 мм и проволоку 1,2 обыкновенного качества отожженную или светлую. Существуют следующие виды фундамента: столбчатые, ленточные (монолитные или сборные), плитные и свайные. Для каждого вида необходимо правильно подобрать диаметр и класс прутка. Итак, для изготовления плитного фундамента нужно использовать арматуру с рифлёной поверхностью и диаметром не меньше 10 мм класса А500С, 35ГС. Для ленточного фундамента при строительстве индивидуальных домов в основном используется арматура 10-12 мм, реже 14 мм. Столбчатый фундамент. Для армирования столбиков нет смысла использовать толстую арматуру, диаметром 10 мм будет вполне достаточно. Для вертикальных прутков используется рифлёная арматура, горизонтальные прутки используется только для того, чтобы связать их в единый каркас. Чаще всего для столбика арматурный каркас изготавливают из 2-4 прутков, при этом их длина равняется высоте столба.

Итак, для изготовления плитного фундамента нужно использовать арматуру с рифлёной поверхностью и диаметром не меньше 10 мм класса А500С, 35ГС. Для ленточного фундамента при строительстве индивидуальных домов в основном используется арматура 10-12 мм, реже 14 мм. Столбчатый фундамент. Для армирования столбиков нет смысла использовать толстую арматуру, диаметром 10 мм будет вполне достаточно. Для вертикальных прутков используется рифлёная арматура, горизонтальные прутки используется только для того, чтобы связать их в единый каркас. Чаще всего для столбика арматурный каркас изготавливают из 2-4 прутков, при этом их длина равняется высоте столба.

Виды фундаментов

Ленточные фундаменты

Такой вид фундамента закладывают при строительстве дома с тяжелыми бетонными, каменными, кирпичными стенами, а так же с тяжелыми перекрытиями. Этот вид фундамента необходим, при обустройстве подвала, гаража под домом или же предполагается цокольный этаж. При опасности возникновения неравномерных деформаций основания также возможно заложение ленточного фундамента при этом в них устраивают непрерывные армированные пояса. Расположение подошвы в таком фундаменте на 20 см ниже глубины промерзания грунта. На сухих или песчаных грунтах закладывается мелкозаглубленный фундамент (выше глубины промерзания, но не меньше 50-60см). Ленточные фундаменты редко применяются на сильно пучинистых и глубоко промерзающих грунтах. Ленточный фундамент бывает двух видов — монолитный и сборный.

Расположение подошвы в таком фундаменте на 20 см ниже глубины промерзания грунта. На сухих или песчаных грунтах закладывается мелкозаглубленный фундамент (выше глубины промерзания, но не меньше 50-60см). Ленточные фундаменты редко применяются на сильно пучинистых и глубоко промерзающих грунтах. Ленточный фундамент бывает двух видов — монолитный и сборный.

Плитные фундаменты

Используются на неравномерно и сильно сжимаемых грунтах. Такие фундаменты часто называют «плавающими». Их большая опорная поверхность позволяет значительно снизить давление на грунт, а ребра жесткости придают этим конструкциям достаточную устойчивость к действию разнонаправленных нагрузок, возникающих при замерзании, оттаивании и просадке грунта. Фундаментные плиты — один из самых надежных вариантов фундамента, но при этом и один из самых дорогих. Устройство плавающих фундаментов требует большего расхода материалов — высокопрочного бетона и арматурной стали — и может быть оправдано в том случае, когда другие варианты фундаментов не могут обеспечить необходимую устойчивость на сильно пучинистых и слабонесущих грунтах. Толщина монолитной плиты даже для малоэтажных домов не может быть меньше 250 мм, а плотность армирования ниже 100 кг/м3. Стоимость такого фундамента повышается в силу необходимости устройства под плитой песчаной и щебеночной подушек толщиной 100-150 мм каждая.

Толщина монолитной плиты даже для малоэтажных домов не может быть меньше 250 мм, а плотность армирования ниже 100 кг/м3. Стоимость такого фундамента повышается в силу необходимости устройства под плитой песчаной и щебеночной подушек толщиной 100-150 мм каждая.

Столбчатые фундаменты

Такой вид фундамента применяют для домов с легкими стенами — деревянными, каркасно-щитовыми, стенами из блоков несъемной опалубки. Данный тип фундамента в 1,5-2 раза экономичнее ленточных по расходу материалов. Столбы возводятся во всех углах, местах пересечения стен, под простенками, под опорами тяжело нагруженных прогонов и в других точках сосредоточения нагрузок. Столбы могут быть деревянными, каменными, кирпичными, бетонными и железобетонными.

Промежуточное положение между сборными и монолитными занимают сборно-монолитные фундаменты. Основа такого фундамента — сборно-монолитные железобетонные конструкции, включающие в себя тонкостенную сборную несъемную опалубку стен и перекрытий, изготовленную в заводских условиях.

Буронабивные свайные фундаменты

Такие фундаменты используются для небольших домов без подвала. При использовании свай большого диаметра и глубины буронабивные фундаменты можно применять для тяжелых и очень тяжелых зданий и объектов. В некоторых случаях только буронабивные фундаменты позволяют реализовать проект. Плотность застройки, значительные динамические нагрузки на соседние здания при устройстве забивных свай все чаще заставляют специалистов обращать внимание на буронабивные свайные фундаменты.

Лучшее время для закладки фундамента — весна, зимой закладке мешает минусовая температура(из-за минусовой температуры вода в бетонной смеси, замерзает, что категорически противопоказано для бетона).

Deepmind Ada привносит базовые модели в обучение с подкреплением

Содержание Краткое содержание AdA Deepmind показывает, что базовые модели также позволяют использовать универсальные системы в обучении с подкреплением, которые быстро изучают новые задачи.

В исследованиях ИИ термин «основная модель» используется некоторыми учеными для обозначения больших предварительно обученных моделей ИИ, обычно основанных на архитектурах-трансформерах. Одним из примеров является большая языковая модель OpenAI GPT-3, которая обучена предсказывать текстовые токены, а затем может выполнять различные задачи с помощью быстрой разработки в несколько шагов.

Короче говоря, базовая модель — это большая модель ИИ, которая благодаря универсальному обучению с большими наборами данных впоследствии может выполнять многие задачи, для которых она не была специально обучена.

AdA Deepmind учится в контексте

Предыдущие базовые модели основывались главным образом на самоконтролируемом обучении. Теперь Deepmind представляет «Адаптивный агент» (AdA), агент обучения с подкреплением, обладающий характеристиками базовой модели.

Команда Deepmind обучила AdA многочисленным прогонам в среде XLand 3D, полагаясь на интеллектуальный выбор каждой задачи: вместо случайного выбора задач, AdA всегда тренируется на задачах, которые чуть выше текущего уровня навыков агента . Задачи требуют таких навыков, как экспериментирование, навигация, координация или разделение труда с другими агентами.

Задачи требуют таких навыков, как экспериментирование, навигация, координация или разделение труда с другими агентами.

Поделиться

Порекомендуйте нашу статью

AdA опирается на специальную архитектуру Transformer, которая позволяет агенту хранить значительно больше информации, обеспечивая эффективное обучение, согласно Deepmind.

Кроме того, команда использует дистилляцию с подходом «учитель-ученик» для ускорения процесса обучения и обучения более крупных моделей. В документе компания обучила модель с 265 миллионами параметров и показала, что с помощью этого метода можно получить 500 миллионов параметров.

Deepmind AdA учится в XLand 2.0

Обучение модели Transfomer миллионами прогонов в среде XLand создает базовую модель RL, пишет Deepmind. AdA демонстрирует «поведение исследования, основанное на гипотезах» при изучении новых задач, используя полученную информацию для уточнения стратегий и достижения почти оптимальной производительности.

Процесс занимает всего несколько минут, даже для сложных задач, что делает его человеческим, согласно Deepmind. Причем весь процесс возможен без обновления весов в сети. Как и GPT-3, AdA имеет несколько возможностей, а процесс обучения происходит в контекстном окне модели.

Рекомендация

В этой статье мы впервые демонстрируем, насколько нам известно, агента, обученного RL, который способен к быстрой адаптации в контексте в обширном, открытом пространстве задач, в масштабе времени, аналогичном человеческие игроки. Этот адаптивный агент (AdA) структурно исследует отложенные задачи, уточняя свою политику в отношении оптимального поведения с учетом лишь нескольких взаимодействий с задачей.

Из статьи

AdA основан на методе мета-обучения с подкреплением «черный ящик» и показывает, вопреки предыдущим предположениям, что метод является масштабируемым, говорит Deepmind. Учитывая законы масштабирования языковых моделей или других базовых моделей, модели RL, такие как AdA, могут стать основой для полезных моделей RL для решения реальных проблем в будущем.

Дополнительную информацию и примеры можно найти на странице проекта AdA.

Теоретические основы обучения с подкреплением

Теоретические основы обучения с подкреплением Алех Агарвал, Акшай Кришнамурти и Джон ЛэнгфордОбзор

Это учебник по теоретическим основам обучения с подкреплением, охватывающий множество новых разработок за последние полвека, которые существенно углубляют наше понимание того, что возможно и почему. Кроме того, мы охватываем различные важные открытые проблемы. Учебное пособие состоит из 3 ключевых частей: информационная теория обучения с подкреплением, оптимизация/градиентный спуск в обучении с подкреплением и обнаружение латентного состояния.Учебное видео

Резервное видеослайды

Первичные ссылки

- Чи Джин, Чжуоран Ян, Чжаоран Ван и Майкл И. Джордан. Доказуемо эффективное обучение с подкреплением с приближением линейной функции. КОЛЬТ, 2020.

- Даниэль Руссо и Бенджамин Ван Рой.

Размерность Eluder и сложность выборки оптимистического исследования. НеврИПС, 2013. .

Размерность Eluder и сложность выборки оптимистического исследования. НеврИПС, 2013. . - Нан Цзян, Акшай Кришнамурти, Алех Агарвал, Джон Лэнгфорд и Роберт Э. Шапир. Контекстные процессы принятия решений с низким рангом Беллмана поддаются обучению PAC. ICML, 2017.

- Вэнь Сун, Нан Цзян, Акшай Кришнамурти, Алех Агарвал и Джон Лэнгфорд. RL на основе моделей в контекстных процессах принятия решений: ограничения PAC и экспоненциальные улучшения по сравнению с подходами без моделей. КОЛЬТ, 2019.

- Алех Агарвал, Шам М. Какаде, Джейсон Д. Ли и Гаурав Махаджан. К теории методов градиента политики: оптимальность, аппроксимация и сдвиг распределения. КОЛЬТ, 2020.

- Алех Агарвал, Микаэль Хенафф, Шам Какаде и Вен Сун. PC-PG: Направленное исследование прикрытия политики для доказуемого изучения градиента политики. НейрИПС, 2020.

- Дипендра Мишра, Микаэль Хенафф, Акшай Кришнамурти и Джон Лэнгфорд. Абстракция кинематического состояния и доказуемо эффективное обучение с подкреплением на основе богатого наблюдения.

ICML, 2020.

ICML, 2020. - Алех Агарвал, Шам Какаде, Акшай Кришнамурти и Вен Сун. FLAMBE: Структурная сложность и изучение представлений MDP низкого ранга. НейрИПС, 2020.

- Закария Мхаммеди, Дилан Дж. Фостер, Макс Симховиц, Дипендра Мишра, Вен Сун, Акшай Кришнамурти, Александр Рахлин и Джон Лэнгфорд. Изучение линейного квадратичного регулятора на основе нелинейных наблюдений. НейрИПС, 2020.

Другие ссылки

Нижние границы

- Майкл Кернс, Ишай Мансур и Эндрю Нг. Алгоритм разреженной выборки для почти оптимального планирования в больших марковских процессах принятия решений. Машинное обучение, 2002. .

- Акшай Кришнамурти, Алех Агарвал и Джон Лэнгфорд. Обучение с подкреплением PAC с богатыми наблюдениями. НеврИПС, 2016. .

- Саймон С. Ду, Шам М. Какаде, Руосонг Ван, Линь Ф. Ян. Достаточно ли хорошего представления для выборочного эффективного обучения с подкреплением? ICLR, 2020.

- Геллерт Вайс, Филип Амортила и Чаба Сепешвари.

Экспоненциальные нижние границы для планирования в MDP с линейно реализуемыми оптимальными функциями действия-ценности. архив: 2010.01374, 2020.

Экспоненциальные нижние границы для планирования в MDP с линейно реализуемыми оптимальными функциями действия-ценности. архив: 2010.01374, 2020. - Руосонг Ван, Дин П. Фостер и Шам М. Какаде. Каковы статистические пределы автономного RL с приближением линейной функции? архив: 2010.11895, 2020.

Три испытания

- Ричард Беллман. Теория динамического программирования. Бюллетень Американского математического общества, 1954.

- Эдсгар В. Дейкстра. Заметка о двух проблемах, связанных с графами. Числовая математика, 1959. .

- Карло Э. Бонферрони. Классическая статистическая теория и расчет вероятностей. 1936.

- Владимир Николаевич Вапник и Алексей Я. Червоненкис. О равномерной сходимости относительных частот событий к их вероятностям. Теория вероятностей и ее приложения, 1971. .

- Лесли Г. Валиант. Теория обучаемости. Связи АКМ, 1984.

Контекстные бандиты

- Уильям Р.

- Питер Ауэр, Николо Чеза-Бьянки, Йоав Фройнд и Роберт Э. Шапире. Нестохастическая задача о многоруком бандите. SIAM Journal on Computing, 2002. Предварительная версия в FOCS, 1995. .

- Джон Лэнгфорд и Тонг Чжан. Жадный до эпохи алгоритм для контекстных многоруких бандитов. НеврИПС, 2007.

- Лихонг Ли, Вэй Чу, Джон Лэнгфорд и Роберт Э. Шапир. Контекстно-бандитский подход к персонализированной рекомендации новостных статей. WWW, 2010.

- Мирослав Дудик, Даниэль Хсу, Сатьен Кале, Никос Карампациакис, Джон Лэнгфорд, Лев Рейзин и Роберт Э. Шапире. Эффективное оптимальное обучение для контекстных бандитов. УАИ, 2011.

- Алех Агарвал, Даниэль Хсу, Сатьен Кале, Джон Лэнгфорд, Лихонг Ли и Роберт Э. Шапир. Приручение монстра: быстрый и простой алгоритм для контекстных бандитов. ICML, 2014.

- Дилан Дж.

Фостер и Александр Рахлин. Помимо UCB: оптимальные и эффективные контекстные бандиты с оракулами регрессии. ICML, 2020.

Фостер и Александр Рахлин. Помимо UCB: оптимальные и эффективные контекстные бандиты с оракулами регрессии. ICML, 2020. - Дэвид Симчи-Леви и Юньцзун Сюй. Обход монстра: более быстрый и простой оптимальный алгоритм для контекстных бандитов в условиях реализуемости. архив: 2003.12699, 2020.

Табличный марковский процесс принятия решений

- Майкл Кернс и Сатиндер Сингх. Почти оптимальное обучение с подкреплением за полиномиальное время. Машинное обучение, 2002.

- Ронен И. Брафман, Моше Тенненхольц. R-max-общий алгоритм полиномиального времени для почти оптимального обучения с подкреплением. JMLR, 2002. .

- Александр Л. Стрель, Лихонг Ли, Эрик Вевиора, Джон Лэнгфорд и Майкл Л. Литтман. Обучение с подкреплением без модели PAC. ICML, 2006.

- Томас Якш, Рональд Ортнер и Питер Ауэр. Почти оптимальные границы сожаления для обучения с подкреплением. JMLR, 2010.

- Мохаммад Гешлаги Азар, Ян Осбанд и Реми Мунос.

Минимаксные границы сожаления для обучения с подкреплением. ICML, 2017.

Минимаксные границы сожаления для обучения с подкреплением. ICML, 2017. - Кристоф Данн, Тор Латтимор и Эмма Бранскилл. Объединение PAC и сожаления: унифицированные границы PAC для эпизодического обучения с подкреплением. НеврИПС, 2017.

- Чи Джин, Зеюань Аллен-Чжу, Себастьен Бубек и Майкл И. Джордан. Является ли Q-обучение доказуемо эффективным? НейрИПС, 2018.

- Андреа Занетт и Эмма Бранскилл. Более жесткие границы сожаления, зависящие от проблемы, в обучении с подкреплением без знания предметной области с использованием границ функции ценности. ICML, 2019.

- Макс Симховиц и Кевин Дж. Джеймисон. Неасимптотические границы сожаления, зависящие от пропусков, для табличных MDP. НейрИПС, 2019.

Линейные бандиты

- Барух Авербух и Роберт Клейнберг. Онлайн-линейная оптимизация и адаптивная маршрутизация. JCSS, 2008. Предварительная версия в STOC, 2004.

- Элад Хазан, Зохар Карнин и Рагху Мека.

Объемные гаечные ключи: эффективная исследовательская база для обучения. КОЛЬТ, 2014.

Объемные гаечные ключи: эффективная исследовательская база для обучения. КОЛЬТ, 2014. - Варша Дани, Томас П. Хейс и Шам М. Какаде. Стохастическая линейная оптимизация при бандитской обратной связи. КОЛЬТ, 2008.

- Ясин Аббаси-Ядкори, Чаба Сепешвари и Давид Пал. Улучшены алгоритмы для линейных стохастических бандитов. НеврИПС, 2011. .

Методы экстраполяции для RL

- Линь Ф. Ян и Менгди Ван. Обучение с подкреплением в функциональном пространстве: матричный бандит, ядра и сожаление. ICML, 2020.

- Андреа Занетт, Алессандро Лазарик, Микель Кохендерфер и Эмма Бранскилл. Обучение, близкое к оптимальному, с низкой присущей ему ошибкой Беллмана. ICML, 2020.

- Руосонг Ван, Руслан Салахутдинов и Линь Ф. Ян. Обучение с подкреплением с аппроксимацией общей функции ценности: доказуемо эффективный подход с помощью ограниченного измерения уклонения. НейрИПС, 2020.

Bellman и ранг свидетеля

- Кефан Дун, Цзянь Пэн, Инин Ван и Юань Чжоу.

\sqrt{n}-Сожаление об обучении марковским процессам принятия решений с аппроксимацией функций и низким рангом Беллмана. КОЛЬТ, 2020.

\sqrt{n}-Сожаление об обучении марковским процессам принятия решений с аппроксимацией функций и низким рангом Беллмана. КОЛЬТ, 2020.

Факторные MDP

- Майкл Кернс и Дафна Коллер. Эффективное обучение с подкреплением в факторизованных MDP. IJCAI, 1999.

- Мартин Мундхенк, Джуди Голдсмит, Кристофер Лусена и Эрик Аллендер. Сложность марковских задач принятия решений на конечном интервале времени. Журнал АКМ, 2000.

- Эрик Аллендер, Санджив Арора, Майкл Кернс, Кристофер Мур и Александр Рассел. Замечание о репрезентативной несовместимости аппроксимации функций и факторизованной динамики. НеврИПс, 2002.

- Паоло Либераторе. Размер полисов с учетом MDP. АААИ, 2002.

- Ян Осбанд и Бенджамин Ван Рой. Почти оптимальное обучение с подкреплением в факторизованных MDP. НеврИПС, 2014. .

- Авив Розенберг и Ишай Мансур. Oracle-эффективное обучение с подкреплением в факторизованных MDP с неизвестной структурой.

архив: 2009.05986.

архив: 2009.05986.

Алгоритмы оптимизации политик

- Рональд Дж. Уильямс. Простые статистические алгоритмы следования за градиентом для коннекционистского обучения с подкреплением. Машинное обучение, 1992.

- Виджай Р. Конда и Джон Н. Цициклис. Алгоритмы актер-критик. НейрИПС, 2000. .

- Ричард С. Саттон, Дэвид Макаллестер, Сатиндер Сингх и Ишай Мансур. Методы градиента политики для обучения с подкреплением с аппроксимацией функции. НейрИПС, 2000. .

- Шам М. Какаде. Градиент естественной политики. НеврИПС, 2001. .

- Шам М. Какаде и Джон Лэнгфорд. Приблизительно оптимальное приблизительное обучение с подкреплением. ICML, 2002. .

- Дж. Эндрю Бэгнелл и Джефф Шнайдер. Поиск ковариантной политики. IJCAI, 2003. .

- Ян Петерс, Сету Виджаякумар и Стефан Шаал. Природный актер-критик. Нейрокомпьютинг, 2008. .

- Джон Шульман, Сергей Левин, Филипп Мориц, Майкл И. Джордан и Питер Аббил.

Оптимизация политик доверенных регионов. ICML, 2015.

Оптимизация политик доверенных регионов. ICML, 2015. - Джон Шульман, Филип Вольский, Прафулла Дхаривал, Алек Рэдфорд и Олег Климов. Алгоритмы оптимизации проксимальной политики. arXiv: 1707.06347, 2017.

- Туомас Хаарноя, Аурик Чжоу, Питер Аббил и Сергей Левин. Мягкий актер-критик: внеполитическое глубокое обучение с подкреплением с максимальной энтропией со стохастическим актером. ICML, 2018.

Алгоритмы оптимизации политик

- Эяль Эвен-Дар, Шам. М. Какаде и Ишай Мансур. Марковские онлайн-процессы принятия решений. Математика исследования операций, 2009. .

- Бруно Шеррер. Примерные схемы итерации политики: сравнение. ICML, 2014.

- Гергели Ной, Андерс Йонссон и Висенс Гомес. Единый взгляд на энтропийно-регуляризованные марковские процессы принятия решений. архив: 1705.17798, 2017.

- Матье Гейст, Бруно Шеррер и Оливье Пьекен. Теория регуляризованных марковских процессов принятия решений.

ICML, 2019.

ICML, 2019. - Ясин Аббаси-Ядкори, Питер Бартлетт, Куш Бхатиа, Невена Лазич, Чаба Сепешвари и Геллерт Вайс. ПОЛИТЕКС: Сожаление о границах для итерации политики с использованием прогнозов экспертов. ICML, 2019.

- Джаладж Бхандари и Даниэль Руссо. Гарантии глобальной оптимальности для градиентных методов политики. arXiv:1906.01786, 2019.

- Лиор Шани, Йонатан Эфрони и Ши Маннор. Оптимизация политики адаптивного региона доверия: глобальная конвергенция и более высокие скорости для регуляризованных MDP. АААИ, 2020.

- Цзиньчэн Мэй, Ченцзюнь Сяо, Чаба Сепешвари и Дейл Шуурманс. О глобальных скоростях сходимости градиентных методов политики softmax. НейрИПС, 2020.

Исследования в области оптимизации политик

- Ци Кай, Чжуоран Ян, Чи Цзинь и Чжаоран Ван. Доказуемо эффективное исследование в области оптимизации политики. ICML, 2020.

- Йонатан Эфрони, Лиор Шани, Авив Розенберг и Ши Маннор.

Оптимистичная оптимизация политики с бандитской обратной связью. ICML, 2020.

Оптимистичная оптимизация политики с бандитской обратной связью. ICML, 2020.

Обнаружение скрытого состояния

- Роберт Гиван, Томас Дин и Мэтью Грейг. Понятия эквивалентности и минимизация модели в марковских процессах принятия решений. Искусственный интеллект, 2003.

- Лихонг Ли, Томас Дж. Уолш и Майкл Л. Литтман. К единой теории абстракции состояния для MDP. Международный симпозиум по искусственному интеллекту и математике, 2006 г.

- Дипак Патхак, Пулкит Агравал, Алексей А. Эфрос и Тревор Даррелл. Исследование, движимое любопытством, путем самоконтролируемого предсказания. ICML, 2017.

- Хаоран Тан, Рейн Хутуфт, Дэвис Фут, Адам Стоук, Си Чен, Ян Дуан, Джон Шульман, Филип Де Турк и Питер Аббил. #Исследование: исследование исследования на основе подсчета для глубокого обучения с подкреплением. НеврИПС, 2017.

- Адитья Моди, Нан Цзян, Амбудж Тевари и Сатиндер Сингх. Примерная сложность обучения с подкреплением с использованием линейно комбинированных модельных ансамблей.

Считаются самыми прочными и предназначены для высотного строительства на любых грунтах, кроме переувлажненных.

Считаются самыми прочными и предназначены для высотного строительства на любых грунтах, кроме переувлажненных. 7м

7м